Meta dijo que los anunciantes tendrán que manifestar si usaron Inteligencia Artificial (IA) u otro software para crear o alterar las imágenes o audios en publicidad política. El requisito tendrá efecto globalmente en Facebook e Instagram a comienzo del próximo año.

“Los anunciantes que hagan publicidad de problemas sociales, elecciones y política con Meta tendrán que decir si la imagen o el sonido han sido creados o alterados digitalmente, incluso con AI, para hacer decir a gente real cosas que no han hecho o dicho”, dijo en una publicación de Threads el presidente de asuntos globales de Meta, Nick Clegg.

Los anunciantes también tendrán que revelar cuando usan IA para crear gente o eventos realistas falsos, agregó.

Además, los socios de verificación de Meta, entre los que ay importantes agencias de noticias, pueden etiquetar contenido como “alterado” si determinan que fue creado o editado de forma que resulte engañosa.

Entre los temores acerca de la cada vez más poderosa IA está el potencial fraude a los votantes durante las elecciones.

Microsofot también planea controlar los contenidos alterados

Otro gigante que está dando pasos para controlar este problema es Microsoft, que planea lanzar a principios de 2024 herramientas que permitan a los candidatos o campañas incluir “credenciales” en imágenes o video que produzcan.

El gigante tecnológico dijo que además desplegará un equipo para ayudar a las campañas a combatir amenazas basadas en la IA como ciberinfluencia o imágenes falsas.

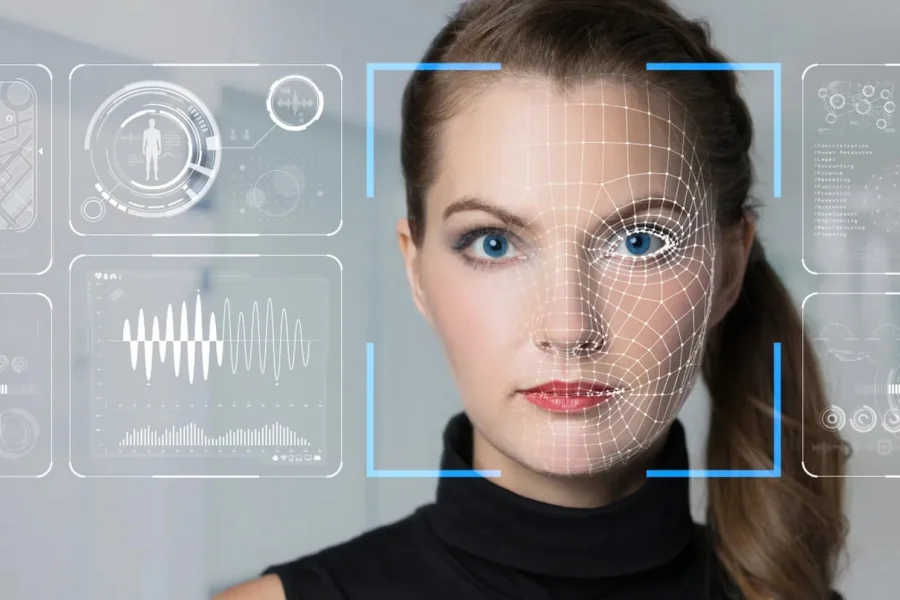

¿Estas seguro que podés reconocer una deepfake?

Joe Biden, vestido de mujer y bebiendo Bud Light; Donald Trump, personificando a un turbio abogado en la serie “Breaking Bad”: los dos contendientes más probables en las elecciones presidenciales estadounidenses de 2024 han sido objeto de recientes videos falsos.

Si bien es muy probable que las falsificaciones protagonizadas por personas públicas se detecten rápidamente como tales, no siempre ocurre lo mismo con las estafas de perfil bajo dirigidas a las finanzas personales o la identidad.

Producto de herramientas de inteligencia artificial “generativa” como ChatGPT, las “deepfakes” o imágenes sintéticas “han alcanzado un nivel de sofisticación que impide su detección a simple vista”, afirman los autores de un reciente estudio multinacional, según el cual la gente está demasiado segura de su propia capacidad para detectar una falsificación.

Quizá no deberían estar tan seguros de sí mismos. “Las ‘deepfakes’ son cada vez mejores y más difíciles de detectar sin la ayuda de la inteligencia artificial”, afirma Stuart Wells, responsable de Tecnología de Jumio.

Comentarios